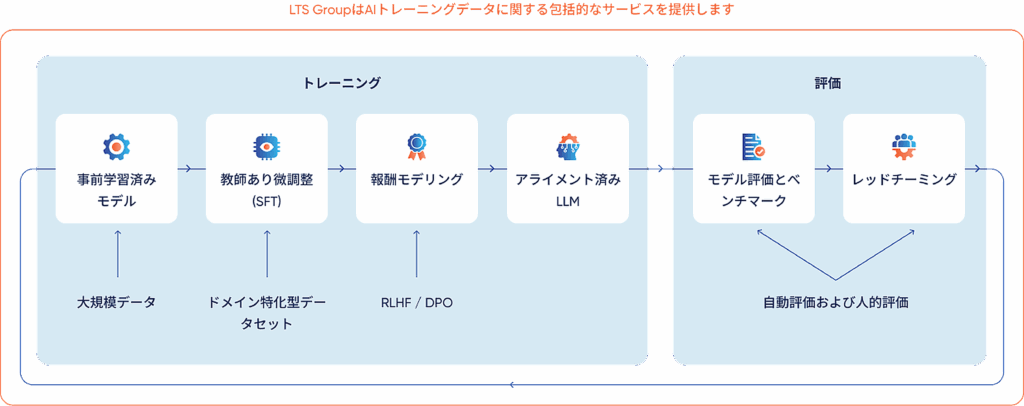

エンドツーエンドのLLMトレーニングサービス

大規模言語モデル(LLM) 向けデータセット

テキストデータにとどまらず、次世代のLLMや物理AIの発展をリードする、高精度なマルチモーダル・マルチセンサーデータセットの構築と提供を行っています。これらのデータを効果的に組み合わせることで、単なる生成AIチャットボットだけでなく、自動運転やロボティクス、IoT分野におけるAIモデルの高度化を強力にサポートします。

レガシーデータのモダナイゼーション・デジタル化

レガシーデータをLLMの学習に直結する高品質なAI対応データに昇華。 紙媒体やPDFなどの非構造化データを、LLMが文脈を正確に理解できる形式(MarkdownやJSON)に変換します。日本語や専門用語に特化したAI-OCRと高度なクレンジングで、従来のOCRでは認識が難しかった段落、カラム、表組みを正確に読み取ります。

RAGおよびSFT向けデータ構造化

文脈に応じた適切なチャンキング、メタデータ付与、および向けの高品質なQAデータ作成を実行します。これにより、医療、法務、金融など専門性の高い分野においても、検索精度を最大化し、チャットボットの回答精度を飛躍的に向上させます。

特化型モデルの教師ありファインチューニング(SFT)

構造化されたナレッジを基に、LLM自体の「振る舞い」と「出力スタイル」をチューニングします。一般的な生成AIにありがちな不自然な日本語を解消し、貴社のトーン&マナーや、日本のビジネス文化に基づく適切な敬語表現をモデルに学習させます。単なる知識の検索にとどまらず、違和感のない自然な対話で実務に即座に活用できる「貴社専属のAI頭脳」を構築します。

ヒューマン・イン・ザ・ループ(HITL)によるAI最適化

モデルの精度や安全性を人間の感覚と一致させるため、専門家介入によるHITLプロセスを提供します。人間のフィードバックを用いた強化学習(RLHF)や直接選好最適化(DPO)などの先進的な手法を活用し、AIの生成結果を「論理性・正確性・倫理的妥当性」の観点から厳密に評価し、必要に応じて修正します。複雑なマルチターン対話においても、貴社の意図に沿った高品質な回答を生成できるようAIの振る舞いを継続的に導きます。

LLMの性能評価とレッドチーム演習

LLMのパフォーマンス評価として、A/Bテストや業界ベンチマーク測定をするとともに、悪意のある入力からシステムを守るレッドチーム演習を実施します。 単なる正答率の比較だけでなく、ハルシネーション、バイアス、情報漏洩リスクなどの脆弱性を徹底的に洗い出します。実際のビジネスシナリオを想定した敵対的テストを行うことで、企業のブランド棄損を防ぎ、安全で信頼性の高いAI運用を担保します。

幅広い業界に対応するLLMソリューション

製造・エンジニアリング

紙の図面や複雑なCAD・PDFデータの高度な構造化、マルチセンサデータのラベル付けによる予兆検知AIの構築など、製造業の技術資産を最大限に活用するLLM環境を提供します。

金融・会計

日本語特有の書式に対応したAI-OCRによる請求書や領収書の高精度なデータ化に加えて、LLMソリューションによって、有価証券報告書や決算説明会議事録などの膨大な金融データの解析をサポートします。さらに、学習前の徹底的なデータ匿名化により、機密性の高い財務情報を安全に管理できる環境を整えます。

リテール・小売

「おもてなし」のデジタル化とオペレーションの効率化を両立します。コンシェルジュ型チャットボットによる接客自動化や、数万件のカスタマーレビューから重要なインサイトの抽出を支援します。また、過去のトレンドデータを活用した需要予測・在庫管理の高度化により、売上の最大化と廃棄ロスの削減を実現します。

コンピュータサイエンス

開発プロセスの自動化と技術的負債の解消をLLMで加速。独自のコーディング規約に最適化したモデル構築や、レガシーコードの解析・ドキュメント化を支援します。さらに、レッドチーム演習により、AI生成コードの安全性と高品質なシステム開発を両立します。

医療・ヘルスケア

診察記録の自動要約や診断支援AI向けの高度な医学用語アノテーション、膨大な医学論文・治験データの構造化などを実現します。これにより、深刻な人手不足が続く医療現場の働き方改革に貢献します。AIが農作物の状態を判断し、ロボットが精密な作業を行うための、高解像度な教師データを生成します。これにより、収穫・選別作業を自動化し、人手不足を解消します。また、ドローン画像から病害箇所を早期発見したり、生育状況を分析したりすることで、日本農産物が世界に誇る一流の品質を維持・向上させることに貢献します。

教育・エドテック

理解度に応じたAI家庭教師の構築、テスト問題や教材の自動生成、記述式回答のリアルタイムな添削とフィードバックを、LLMを用いてサポートします。これにより、生徒一人ひとりに最適化された学習体験を提供し、教育者の業務負担を軽減します。

得意業界

お客様が設定された目標をより短期間で達成することに貢献します。

データアノテーションサービスのワークフロー

専任のプロジェクトマネージャーがお客様と密接に連携し、ビジネス目標、データソース、LLMトレーニングのニーズを深く理解します。モデルのスコープ、ドメイン要件、学習手法、コンプライアンス、期待される成果、およびコスト要因を多角的に評価。これに基づき、プロジェクト開始前にお客様のビジョンと合致した最適なトレーニング戦略を提案します。

社内の専門家および、必要に応じて世界各地域のパートナーを含む専任デリバリーチームを編成します。プロジェクトの目標、アノテーション基準、データ作成手法についてチーム全体でトレーニングを実施。初日から全員がワークフローを完璧に理解し、円滑に業務を遂行できる体制を整えます。

本格的なスケールアップの前に、プロセスを検証するための試行タスクを実施します。成果物をお客様に共有してレビューを受け、フィードバックをガイドラインに即座に反映。このステップにより、例外ケースの明確化と品質の安定化を図り、トレーニングプロセスがビジネス目標に完全に合致していることを確認します。

厳格な納期管理と定期的な品質チェックのもと、大規模なLLMトレーニングおよびファインチューニングを遂行します。専門チームが各タスクを分担し、定期的なミーティングを通じてお客様の要望を迅速に反映。LTSはお客様と共に明確な評価基準を定義し、期待される品質に達するまで成果物のブラッシュアップを継続します。

不明確な要件や潜在的な課題をプロアクティブに追跡し、定期的にお客様へ報告します。社内チームでエラーの解決やワークフローの更新を継続的に行うことで、LLMトレーニングの精度を段階的に高め、長期的な成果の最大化を図ります。

なぜLTSが選ばれるのか?

妥協のない品質管理

高精度なLLMトレーニング成果を保証します。多層的なレビュープロセスに加え、クリティカルシンキングと文脈理解に長けた専門家がモデルを精査します。単なるデータ処理ではなく、人間らしい深い理解をAIに吹き込みます。

迅速な体制構築と柔軟な拡張性

グローバルなリソースと効率的なオペレーションにより、大幅なコスト最適化を実現します。お客様の多様なご予算や要件に合わせて、柔軟な価格モデルをご提案します。また、品質を一切妥協することなく、優れた費用対効果をお約束します。

圧倒的なスピードと拡張

トナムの競争力ある人件費に加え、トークナイゼーションの最適化により、トレーニングコストを劇的に削減します。無駄なデータを削ぎ落とし、効率的なデータ構造を構築することで、LLMの運用コストの最小化を支援します。

グローバル対応力と文化的な理解

多様な地域・文化に精通したグローバルチームが、日本語の繊細なニュアンスはもちろん、多言語でのユースケースに対応します。単なる翻訳を超え、各市場の文化的背景を反映したLLMを構築することで、貴社モデルの世界市場での競争力を高めます。

成功導入事例

血球のアノテーション

お客様は生物学、人工知能、モバイルテクノロジー、ロボット工学、ソフトウェア/ハードウェアエンジニアリングの革新を統合することにより、適切なヘルスケアへのアクセスを改善することを依頼しました。

詳細を見る技術スタック

データアノテーション関するよくある質問

通常、2つの主要なステージで構成されます。まず「事前学習」で、多様なソースからの大規模データセットを用いて言語の一般的なパターンを学習します。次に「ポストトレーニング」において、高品質なドメイン特化型データを活用し、教師あり微調整(SFT)、人間からのフィードバックによる強化学習(RLHF)、モデル評価、レッドチーミングなどの手法を適用します。これにより、精度、安全性、およびビジネス固有の要件に合致したモデルへと最適化します。

SFT(教師あり微調整)は、特定のタスク(カスタマーサポート、コード生成など)に特化したラベル付きデータセットを用いて、モデルに特定の振る舞いを学習させるプロセスです。一方、RLHF(人間からのフィードバックによる強化学習)は、モデルの回答を人間が品質、安全性、有用性の観点からランク付けし、そのフィードバックに基づいてモデルを精錬する手法です。これにより、AIの出力をより人間の期待や倫理観に沿ったものに調整します。

検索拡張生成(RAG)は、モデルが学習データ以外の外部知識ベースにアクセスして回答を生成する仕組みです。RAGは最新情報の追加や知識の拡張に優れていますが、モデル自体の根本的な振る舞いは変わりません。対して、LLMトレーニングは、モデルの口調、指示への従い方、基本的な推論能力そのものを変革します。プロジェクトの目的に応じて、RAGとトレーニングのどちらか、あるいは両方を組み合わせて最適な結果を導き出します。

必要となるデータ量はユースケースによって大きく異なります。汎用的な基盤モデルの構築には数千億トークンが必要ですが、特定のドメインに特化したファインチューニングであれば、より小規模でも高品質なデータセットがあれば十分な成果を得ることが可能です。LQAは、ポストトレーニング(SFT、RLHF等)における「量より質」を重視したデータ提供に強みを持っています。

事前学習ステージでは、広範な公開ソースから収集された大規模データが使用されます。一方で、ポストトレーニングやドメイン特化型モデルの構築では、質と専門性が重要視されます。当社では、お客様提供の資料、ライセンス取得済みの独自データベース、および経験豊富な専門家によってキュレーションされた高精度なデータを使用し、関連性と正確性を担保します。