ソフトウェアテストにおけるAI活用は、現代のソフトウェア開発において、スピードと品質の両立を実現するための極めて重要な鍵となっています。

ソフトウェアシステムが複雑化し、リリースサイクルがかつてないほど短縮される中で、クラウドサービスやマイクロサービスの統合、頻繁なアップデートに対応するには、従来のテスト手法だけでは限界があります。また、多くの企業がテストリソースの不足、コストの増大、そして熟練したテストエンジニアの不足という深刻な課題に直面しています。

このような状況下で、単なるテスト AI 自動化の枠を超えた、より高度なインテリジェンスが求められています。AIを活用したアプローチは、過去のテストデータから学習し、潜在的なバグを予測し、テスト戦略を継続的に最適化することを可能にします。これにより、従来のルールベースによる自動テスト AIから、データ主導のスマートな品質保証(QA)へと進化することができるのです。

本記事では、ソフトウェアテスト AIの具体的な活用シーンや導入メリット、そして成功させるための実務的なポイントを詳しく解説します。AI主導のテストが持つ強みと限界の両面を掘り下げることで、Webテスト AIやコーディングテスト AIを検討中の方々へ、AIと人間の専門性をいかに融合させ、ソフトウェア品質を最大化すべきかの指針を提示します。

ソフトウェアテストにおけるAI活用の基礎と役割

AI主導のシステムテストを導入する前に、その基本的な仕組みと、AIがテストプロセスにおいてどのような価値をもたらすのかを正しく理解しておく必要があります。

AIを活用したソフトウェアテストとは?

AIによるソフトウェアテストとは、機械学習、パターン認識、自然言語処理(NLP)などのAI技術を、システムレベルのテスト活動に適用することを指します。

従来の自動テスト AIやスクリプトベースの手法が「あらかじめ定義されたルール」に従うのに対し、AIを搭載したソフトウェアテストは、過去のテストデータから学習し、新しい情報に基づいて自律的に行動を最適化できるのが大きな特徴です。

簡単に言えば、AIの活用によってテストプロセスをよりスマートかつデータ駆動型にし、人間の介入を最小限に抑えつつ、精度とスピードを向上させるアプローチです。

現代のテストツールやフレームワークへのAI統合

実際のテスト環境において、AIは通常、既存のツールを置き換えるのではなく、それらに組み込まれる形で活用されます。その真の価値は、インテリジェントな自動化とデータに基づく意思決定を通じて、特定のテスト活動を強化することにあります。

以下に、実務における一般的なAI統合の例を挙げます。

テストケースの自動生成

AIツールは、アプリケーションの挙動、システムログ、ユーザーフロー、および過去のテストデータを分析して、テストケースを自動生成します。手動作成のみに頼るのではなく、AIが一般的な実行パス、エッジケース、潜在的な失敗シナリオを特定します。これにより、複雑なシステムや変更の多いシステムにおいても、設計工数を大幅に削減しながら広範なテストカバレッジを実現できます。

テストスクリプトの自己修復(セルフヒーリング)

これはテストAI自動化において最も実用的な機能の一つです。従来の自動テストは、UI要素のロケーターやレイアウトが変更されると失敗することが多々ありました。AI搭載ツールはこれらの変更を検知し、元のテストの意図を理解して、手動介入なしでスクリプトを自動更新します。これにより、テストのメンテナンスコストを削減し、テストスイートの長期的な安定性を確保します。

テストの最適化と優先順位付け

AIは過去の実行結果、欠陥のパターン、コードの変更履歴を学習し、テスト実行の最適化を支援します。どのテストが重要な欠陥を検出する可能性が高いかを特定することで、限られた時間内でリスクカバー率を最大化するように実行順序を並べ替えたり、選択したりします。これは、実行時間が制約されるCI/CDパイプラインにおいて特に価値を発揮します。

ビジュアルテストと機能テストの強化

AIは、従来のコードベースの検証では特定が困難なUIの微細な差異や機能的な異常を検知します。AIを活用したビジュアル回帰テストでは、動的なコンテンツやレスポンシブなレイアウトを考慮しつつ、バージョン間のUI状態を比較します。機能面では、Webテスト AIやコーディングテスト AIとして、実行時の挙動やユーザーの操作を分析し、予期しないシステムレスポンスやパフォーマンスの低下を浮き彫りにします。

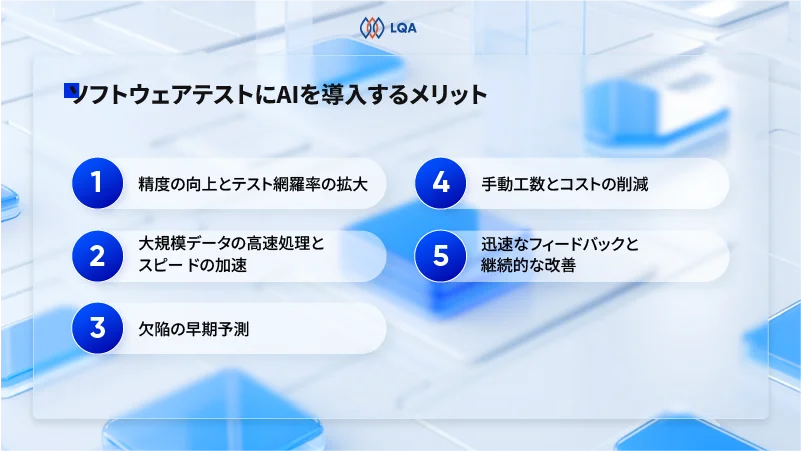

ソフトウェアテストにAIを活用するメリット

ソフトウェアテスト AIは、特にスピード、規模、信頼性が極めて重要な環境において、テストのあらゆる側面に測定可能なメリットをもたらします。

ソフトウェアテストにAIを活用するメリット

精度の向上とテスト網羅率の拡大

AIは、アプリの挙動と過去のデータに基づいてテストケースを自動生成・最適化し、精度を向上させます。継続的な分析を通じて、未テストまたはテスト不足の領域を特定し、カバレッジを適応させます。機械学習モデルが過去の欠陥や使用パターンを学習することで、時間の経過とともにより的を絞った効果的なテストが可能になります。

大規模データの高速処理とスピードの加速

AIを導入することで、テストケースの生成、実行、結果分析といった時間のかかるタスクを自動化できます。人間とは異なり、AIは膨大なデータを高速で処理し、24時間365日稼働し続けることができます。これにより、品質を損なうことなくテストサイクルを大幅に短縮し、迅速なリリースをサポートします。

欠陥の早期予測

AIの最大の強みの一つは、不具合ログ、コードの変更履歴、テストレポート、ユーザーフィードバックなどの履歴データを分析する能力にあります。これらのデータ内のパターンを特定することで、AIは以下のことを可能にします。

-

アプリ内で故障する可能性が最も高いエリアを予測する

-

詳細なテストが必要な高リスクな機能やモジュールを特定する

-

深刻度、ユーザーへの影響、ビジネス価値に基づいて欠陥の優先順位を付ける

これにより、チームは「起きた不具合への対応」から「リスクの未然防止」へとシフトできます。

手動工数とコストの削減

手動テスト、特にリグレッションテストや大規模アプリの検証は労働集約的でコストがかかります。AIは以下の方法でこの負担を軽減します。

-

反復的で価値の低いタスクの自動化

-

適応型メカニズムによるテストスクリプトの手動メンテナンスの最小限化

-

重複したテストを排除し、重要なテストを強調することによるテストスイートの最適化

結果として、リソースをより効率的に配分し、高付加価値なテスト活動に集中できるようになります。

迅速なフィードバックと継続的な改善

ソフトウェア開発ライフサイクル(SDLC)の早期段階で欠陥を検出することで、テストチームと開発チーム間のフィードバックループが短縮されます。早期の改善は開発サイクルを加速させ、反復的なテストを通じた継続的な改善を支え、最終的に安定した信頼性の高いソフトウェアリリースに繋がります。

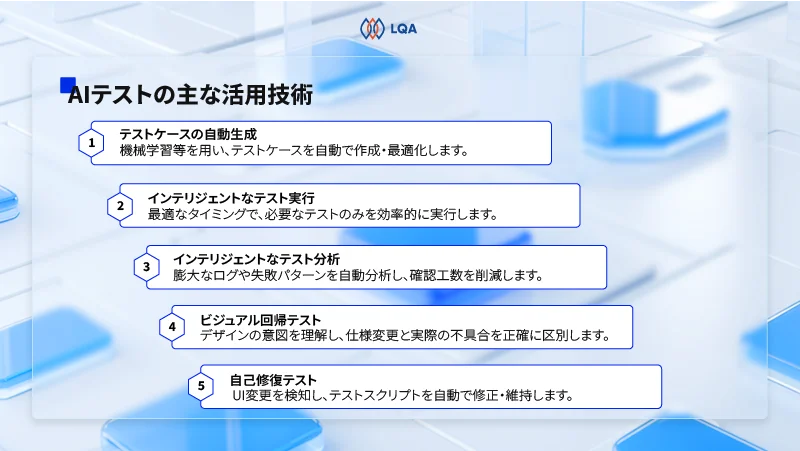

AIを活用したソフトウェアテストの手法

AIを活用した手法は、静的なルールや手動で作成されたスクリプトに依存するのではなく、データ駆動型のインテリジェンスを活用することで、ソフトウェアの変化や進化し続ける品質リスクに適応します。ここでは、主要なソフトウェアテスト AI技術を詳しく解説します。

AIを活用したソフトウェアテストの技術

AIを活用したソフトウェアテストの技術

テストケースの自動生成

AIを活用したテストケース生成では、遺伝的アルゴリズムや機械学習モデルなどの技術を用いて、テストケースを自動的に作成・最適化します。システムの挙動、過去の欠陥、利用パターン、およびソフトウェアのワークフローを分析することで、AIは一般的なユーザーパスとエッジケースの両方を網羅するテストケースを生成できます。

このアプローチは、テスト設計を加速させるだけでなく、手動では漏れが生じやすく時間もかかる複雑なシステムにおいて、テストの妥当性を大幅に向上させます。コーディングテスト AIとしての活用も、この領域で大きな成果を上げています。

インテリジェントなテスト実行

インテリジェントなテスト実行は、「適切なタイミングで適切なテストを実行する」ことに焦点を当てています。

AIは最近のコード変更、過去のテスト結果、欠陥の傾向などの要因を分析し、どのテストケースを優先的に実行すべきか、あるいは実行を省略できるかを判断します。これは、実行時間が限られているCI/CD環境において、迅速かつ意味のあるフィードバックを確保するための優先順位付けとして非常に価値があります。

インテリジェントなテスト分析

テスト結果の分析は、システムテストにおいて最もリソースを消費する活動の一つです。

AIは、実行ログ、失敗パターン、パフォーマンスメトリクスを自動的に分析することで、このプロセスを強化します。テスターは膨大なテスト出力を手動で確認する代わりに、根本原因の示唆、異常検知、失敗の分類といった実用的なインサイトを受け取ることができます。

これにより、調査時間が短縮され、チームは問題の特定ではなく解決に集中できるようになります。

ビジュアル回帰テスト

ピクセル単位の単純な比較だけでは、現代の動的なUIを正確に検証することは困難です。そこで威力を発揮するのが、AIによるビジュアル回帰テストです。

AIが視覚的なコンテキストやレイアウトの意図を理解することで、動的コンテンツやレスポンシブデザインに伴う許容範囲内の変化を、実際の不具合と明確に区別します。

UI更新が頻繁なアプリやマルチデバイス対応が必須のプロジェクトにおいて、Webテスト AIはこれまでにない信頼性とスケーラビリティを検証プロセスにもたらします。

自己修復テスト

自己修復テストは、テスト自動化における最大の課題である「メンテナンス」を解決します。

UI要素に変更が生じた際、AI搭載ツールがその変化を即座に検知します。最も適切な代替要素を特定し、人間が介入することなくテストスクリプトを自動で修正します。テストの意図を維持しながら安定稼働を支えるこの技術は、テスト AI 自動化スイートの寿命を飛躍的に延ばし、従来の自動テスト AIが抱えていた「スクリプトの脆弱性」という難問を根本から解決します。

従来のテストと AI 主導のアプローチの主な違い

以下の表は、従来のテスト手法と、ソフトウェアテストにおけるAI活用アプローチの主な違いをまとめたものです。

|

比較項目 |

従来のテスト手法 |

AI主導のテスト |

|

テストケース作成 |

仕様書に基づき手動で設計 |

データと学習モデルを用いて自動生成・最適化 |

|

柔軟性 |

変更に対する適応力が限定的 |

アプリケーションやデータの変更に高度に適応 |

|

テスト実行スピード |

実行順序や範囲が固定されている |

動的な優先順位付けによる自動テスト AIの高速実行 |

|

エラー検知 |

実行済みテストに基づくリアクティブ型 |

高リスク領域に焦点を当てた予測型 |

|

リソースの活用 |

人手(マニュアル作業)への依存度が高い |

人材と計算リソースの配置を最適化 |

|

回帰テスト |

メンテナンスに多大なコストと時間がかかる |

効率的で自己最適化に優れ、変更に強い(テスト AI 自動化) |

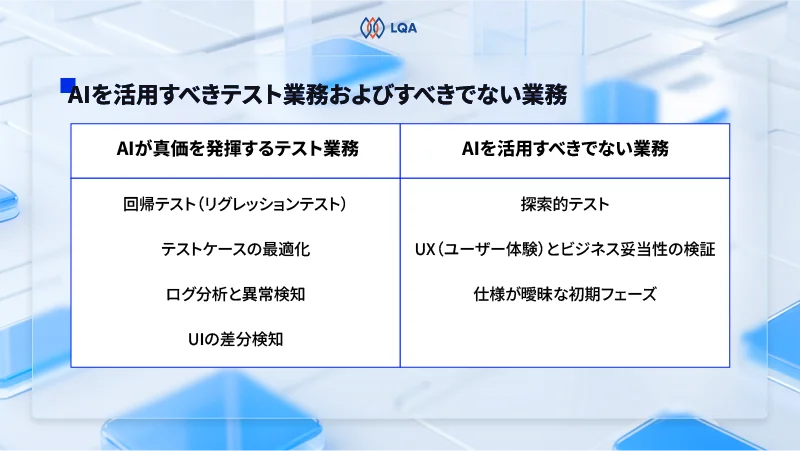

AIを活用すべきテスト業務およびすべきでない業務

AIはソフトウェアテストにおいて強力な武器となりますが、決して万能ではありません。導入を成功させる鍵は、「AIが得意とする領域」と「人間の判断が不可欠な領域」を明確に切り分けることにあります。

データ量、反復性、規模が重視されるタスクにAIを割り当て、創造性や文脈理解、ビジネス視点が必要なタスクには人間の専門性を活用するバランスこそが、持続可能なテスト戦略の土台となります。

AIを活用すべきテスト業務およびすべきでない業務

AIが真価を発揮するテスト業務

回帰テスト(リグレッションテスト)

頻繁なリリースに伴う反復的で膨大な検証は、まさにAIの独壇場です。過去の不具合データやコードの変更履歴に基づき、実行すべきテストをAIが自動で最適化・優先順位付けします。これにより、テスト AI 自動化の網羅率を落とすことなく、メンテナンス工数と実行時間を劇的に削減できます。

テストケースの最適化

プロジェクトの進行とともに肥大化し、重複しがちなテストスイートの「断捨離」もAIが担います。AIはテストの実行履歴や失敗率、ケース間の重複を分析し、どのテストが最も高い価値を持つかを特定します。最小限のリソースで最大限のカバレッジを実現するための「賢い選択」をAIが可能にします。

ログ分析と異常検知

人間が手作業で解析するには不可能なほど膨大なログやモニタリングデータ。AIはここから異常なパターンやシステム故障の予兆を瞬時に見つけ出します。コーディングテスト AIに近い視点でランタイムデータの相関関係を分析することで、根本原因の特定を加速させ、バグの未然防止を強力にバックアップします。

UIの差分検知

頻繁なアップデートやマルチデバイス対応が求められる現代のプロジェクトにおいて、従来のルールベースのUIテストは限界を迎えています。AI搭載のビジュアル比較ツールは、動的コンテンツによる「許容される変化」と「実際の不具合」を正確に見極めます。Webテスト AIの活用により、誤検知を最小限に抑えた信頼性の高い検証が可能になります。

すべきでない業務:人間の判断が不可欠な領域

探索的テスト

直感、経験、そして鋭い洞察力。テスターがシステムと対話しながら予期せぬ欠陥を暴き出すプロセスは、AIには再現できない人間の領域です。AIは注力すべき箇所の示唆はできても、人間特有の柔軟な思考や状況に応じた判断を代替することはできません。

ユーザー体験(UX)とビジネス妥当性の検証

「システムが仕様通りに動くか」を超えて、「ユーザーにとって価値があるか」を評価するには人間の視点が必須です。ユーザーの期待、複雑なビジネスルール、そして社会的な文脈を理解し、共感を持って製品を評価することは、AIが最も苦手とする分野の一つです。

仕様が曖昧な初期フェーズ

要件が流動的でデータが十分に揃っていない開発初期段階では、AIの学習モデルは機能しません。不確実な状況下でリスクを特定し、ステークホルダーと調整しながらテスト戦略を形作っていくのは、依然として人間の重要な役割です。

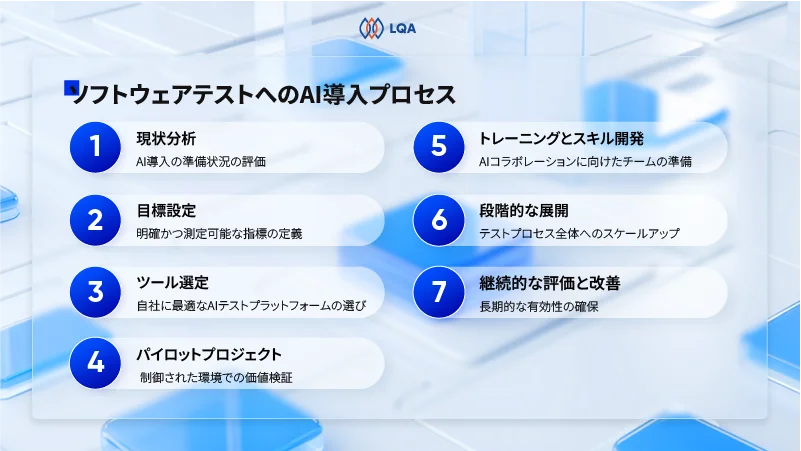

ソフトウェアテストにAIを導入するプロセス

システムテストへのAI導入は、単なるツールの置き換えではなく、テストプロセス、スキル、そしてマインドセットの段階的な変革を意味します。体系的なアプローチを取ることで、リスクを最小限に抑え、コストを制御しながら、AIを単なる「実験的なプロジェクト」に終わらせず、確かな価値を生む資産へと変えることができます。

ソフトウェアテストにAIを導入するステップの7つ

以下に、成功に向けたAI活用プロセスの各ステップについて、詳細に解説します。

ステップ1:現状分析 ― AI導入の準備状況を評価する

AI駆動型のテストを導入する前に、まずは自社のテスト環境の全体像を正確に把握する必要があります。このステップの目的は、AIが現実的にどこで価値を発揮できるのか、逆に従来の手法を維持すべきはどこかを見極めることです。

既存のプロセス、ツール、そして現在直面している課題を洗い出しましょう。一般的に、回帰テスト、テストケースのメンテナンス、ログ分析、UI比較など、反復的でデータ量が多く、手動でのスケールが困難な領域がソフトウェアテストにおけるAI活用の絶好のターゲットとなります。

主な活動内容:

- テストワークフローの可視化:システムテスト、結合テスト、回帰テスト、UAT(ユーザー受け入れテスト)にわたる一連の流れをマッピングします。

- ボトルネックの特定:実行時間の長さ、不安定なテスト、過度な手動工数が発生している箇所を特定します。

- データの質と量の評価:AIモデルは過去のデータに依存するため、テストデータや実行ログが十分に蓄積されているか、信頼できる状態かを確認します。

- チームの適応力評価:現場のスキルレベルや、AIを導入した新しいワークフローを受け入れる準備ができているかを評価します。

ベストプラクティスと留意点:

- 「すべてのテストを一度にAI化」しようとせず、影響度が大きくリスクの低い領域から優先順位を付けます。

- 過去のテスト結果、欠陥ログ、実行レポートが、AIが学習可能な形式でアクセスできる状態にあるかを確認してください。

- プロセスの変更に対する抵抗を最小限に抑えるため、QAリーダーやステークホルダーから早期に合意を得ることが重要です。

ステップ2:目標設定 ― 明確かつ測定可能な指標を定義する

AI導入が失敗する典型的な原因は、目標が曖昧であるか、あるいは過度に野心的であることです。AIを「魔法の杖(万能薬)」として捉えるのではなく、ビジネス成果や品質目標に直結する具体的な目的を定義します。

ソフトウェアテスト AI導入における一般的な目標には、回帰テストの実行時間短縮、欠陥検出率の向上、テストスクリプトの安定化、短期間のリリースサイクルにおける網羅率の最適化などが挙げられます。

目標設定時のチェックポイント

- AIによって解決したい具体的な課題は何か

- 成功をどのように測定するか(実行時間の削減率、バグ流出率、メンテナンス工数の削減などのKPIを設定)

- 短期的な成果と、長期的な変革ゴールの切り分け

ベストプラクティスと留意点

- テストの目標を、リリース頻度の向上やコスト効率化といったビジネス指標と結び付けます。

- AIは「意思決定を支援し、最適化するもの」であり、最初から「完璧な100%の自動化」を期待しすぎないよう、現実的な期待値を設定します。

- 優先順位の競合を避けるため、QAチーム、開発チーム、マネジメント層の間で目標を共有し、自動テスト AIへの認識を一致させます。

ステップ3:ツール選定 ― 自社に最適なAIテストプラットフォームを選ぶ

適切なツールの選択は、プロジェクトの成否を直結させる重要なステップです。ソフトウェアテスト AIツールは、成熟度、適用範囲、統合の容易さが製品によって大きく異なります。

単に「AI機能が優れているか」だけでなく、既存のCI/CDパイプライン、テスト管理システム、不具合追跡ツールといった自社のエコシステムにどれだけスムーズに適合するかを評価してください。

主な評価基準

- 対応しているテスト種別(システム、回帰、ビジュアル、APIテストなど)

- AI固有の機能(自己修復、テスト実行の優先順位付け、異常検知など)

- 既存フレームワーク(Selenium, Playwright, Cypress, Jenkins等)との連携

- データ処理の安全性、セキュリティ、およびコンプライアンス対応

ベストプラクティスと留意点

- 既存のワークフローをすべて置き換えるのではなく、既存の仕組みを「強化」できるツールを優先します。

- クラウドベースのAIモデルを利用する場合、データセキュリティとガバナンスを厳格に評価してください。

- 操作性や定着率を高めるため、選定段階から現場のテスターを関与させることが重要です。

ステップ4:パイロットプロジェクト ― 制御された環境での価値検証

全面導入の前に、特定の範囲でAIの能力を検証するパイロットプロジェクトを実施します。これにより、基幹の開発ラインを止めることなく、AI導入の前提条件を確認し、社内の信頼を構築できます。

パイロットの対象には、頻繁に回帰サイクルが発生し、かつ構造が安定しているモジュールを選ぶのが理想的です。ここでの目的は完璧を目指すことではなく、「学習と検証」にあります。

主な活動内容:

- 限定的なテストスイートに対して、AIによるテスト生成や自己修復機能を適用します。

- AIを活用した結果と、従来のテスト結果を比較・分析します。

- AIの判断に対する信頼性や使い勝手について、テスターからフィードバックを収集します。

ベストプラクティスと留意点:

- 評価が主観的にならないよう、事前に成功基準(KPI)を明確に定義しておきます。

- AIによる誤検知(偽陽性)や誤った判断を注意深くモニタリングしてください。

- パイロットはあくまで学習フェーズであり、ここでの結果を最終判断とせず、改善の材料と捉えます。

ステップ5:トレーニングとスキル開発

AIの導入により、テスターの役割は「スクリプトの実行者」から「AIの出力を監督・解釈・微調整する専門家」へと進化します。適切な教育がなければ、チームはAIを過信しすぎるか、あるいは逆に不信感を抱いて無視してしまうリスクがあります。

トレーニングでは、AIモデルの仕組みや限界、そして人間の判断がいかに自動化を補完するかという概念と技術の両面をカバーする必要があります。

重点を置くべき分野

- AIが提示するインサイトや「信頼度スコア」の正しい解釈方法

- AIが生成したテストケースを前提とした、新しいテスト設計戦略

- データ分析スキルやAIツールの高度な設定・カスタマイズ方法

ベストプラクティスと留意点

- 「完全自動化」ではなく、人間が介在する「Human-in-the-loop」型の協働体制を強調します。

- AIの結果を鵜呑みにせず、常にクリティカル・シンキング(批判的思考)を持ってレビューする文化を育てます。

- 単発の研修で終わらせず、継続的な学習機会を提供してください。

ステップ6:段階的な展開 ― テストプロセス全体へのスケールアップ

パイロットプロジェクトで成果が確認できたら、他の領域へ段階的にAIの適用範囲を広げていきます。一斉導入ではなくフェーズを分けることで、リスクを抑えながら、各現場のフィードバックに基づいた微調整が可能になります。

自動テスト AIの展開は、テスト種別の追加、対象システムの拡大、あるいはCI/CDパイプラインとのより深い統合という形で行われます。

ベストプラクティスと留意点

- 「対象システムを増やす」か「テストの深さを増す」かのどちらか一方に絞り、一度に両方を追わないようにします。

- 定義したKPIに基づき、AIのパフォーマンスを継続的に検証してください。

- 重要なリリースに備え、必要に応じて従来のテスト手法に戻れる「フォールバック」の選択肢を維持しておきます。

ステップ7:継続的な評価と改善 ― 長期的な有効性の確保

AIモデルは時間の経過とともに進化し、その有効性は継続的なフィードバックとデータ更新に依存します。定期的な評価を行うことで、AIがシステムの変更、ビジネス目標、そして倫理的基準から逸脱しないように管理します。

主な活動内容

- AIの判断にバイアスがないか、精度や説明責任が維持されているかの定期監査

- システムの進化を反映させるための、学習データのリフレッシュと再学習

- 人間とAIの協働プロセスの最適化

ベストプラクティスと留意点

- テスト AI 自動化を「一度設定すれば終わり」の静的な仕組みではなく、常に進化し続ける「生きたプロセス」として扱います。

- データの品質を定期的にチェックし、AIモデルが陳腐化するのを防ぎます。

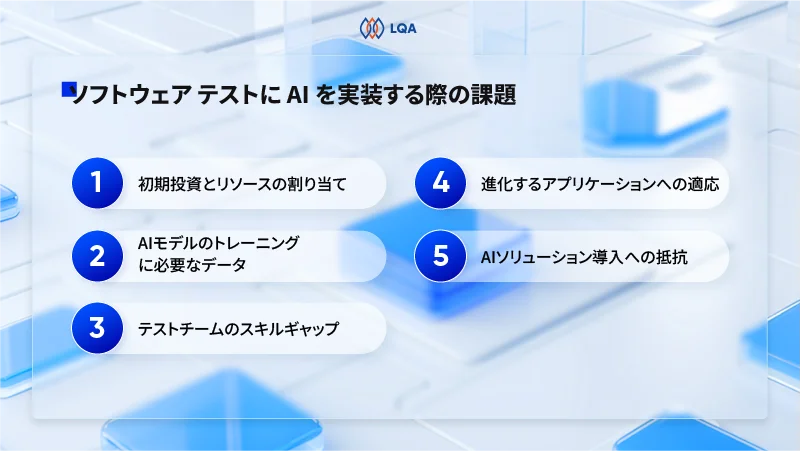

ソフトウェアテストにAIを実装する際の課題

ソフトウェアテストにおけるAI活用は、スケーラビリティや効率性の面で明らかなメリットがある一方で、実際の現場への導入は決して一筋縄ではいきません。多くの企業が直面する困難は、AI技術そのものの未熟さよりも、むしろ予算配分、スキルセット、データの準備、そして組織的なマインドセットの変化が求められる点にあります。特に、日本のような高い品質基準を持つ市場では、これらの課題がより顕著に現れる傾向があります。

ソフトウェアテストにAIを導入する際の課題

初期投資とリソースの割り当て

AI主導のテスト導入における最初の障壁は、先行投資の大きさです。AI搭載のテストツールは、従来の自動化フレームワークと比較して、ライセンス費用、インフラ要件、そして導入のためのオンボーディング工数が高くなる傾向があります。

ツール費用だけでなく、パイロットプロジェクトやトレーニング、プロセス再設計のためのリソースも確保しなければなりません。テスト予算が、戦略的投資ではなく「コストセンター」として捉えられがちな組織では、このリソース確保が大きな摩擦を生むことになります。

主な課題:

- 具体的な成果が出る前に、投資対効果(ROI)を正しく説明することが困難

- 開発、クラウド移行、セキュリティ対策といった他のIT投資との予算争奪

- 短期的費用に対する長期的なコスト削減効果の不透明さ

AIモデルのトレーニングに必要なデータ

AI駆動型のテストは、過去のテストケース、実行ログ、不具合レポート、UIスナップショットなどの高品質なデータに大きく依存します。

しかし、多くの組織においてテストのノウハウは標準化されたデータとしてではなく、個々のテスターの経験や暗黙知として蓄積されてきました。この「職人芸」的なアプローチは高品質なテストを生む一方で、AIモデルが学習に必要とする「履歴データ」や「実行ログ」の統合を困難にしています。

典型的な問題点:

- テスト資産がバラバラなツールや個人のリポジトリに散在している

- テストドキュメントのフォーマットが不統一で、機械学習に適さない

- 教師あり学習に必要な、ラベル付けされたデータが圧倒的に不足している

こうしたデータ整備の課題は、AI導入のスピードを鈍らせる大きな要因となります。自社内での対応が困難な場合は、外部の専門リソースを活用して「AIが学習可能な状態」へデータを整えることが非常に有効です。

LTS Groupでは、散在するデータの収集や標準化をサポートするBPOサービスや、AIモデルの精度を左右する高品質なデータを作成するAIデータアノテーションサービスを提供しています。こうしたプロフェッショナルな支援を受けることで、膨大な過去資産を「価値ある学習データ」へと変換し、AI導入のハードルを大幅に下げることが可能になります。

テストチームのスキルギャップ

ソフトウェアテスト AIを使いこなすには、従来のテスト設計・実行スキルを超えた新しい専門性が必要です。手動テストの正確さやプロセス遵守を重視してきたチームにとって、データ駆動型のアプローチへの転換は容易ではありません。

不足している主なスキル:

- AIの基本概念やデータに基づく意思決定に対する馴染みの薄さ

- AIベースのテストツールの設定やチューニングに関する経験不足

- 役割の変化や職務の代替に対する不安感

進化するアプリケーションへの適応

現代のアプリケーションは、CI/CD、マイクロサービス、頻繁なUI更新を通じて急速に進化しています。AIは理論上、変化に強いとされていますが、実務レベルでは継続的な学習と再学習が必要です。

具体的な困難

- アプリケーションの挙動が大きく変わると、AIモデルが陳腐化する

- フィードバックループが適切に設計されていない場合、メンテナンス工数が増大する

- 迅速なリリーススケジュールとAIの学習サイクルを同期させることの難しさ

特に、従来の日本企業に多い「安定した長いリリースサイクル」に慣れた組織にとって、こうしたダイナミックな調整はリスクが高く、管理が難しいと感じられる場合があります。

AIソリューション導入への抵抗

AI導入への抵抗感は、技術的な問題よりも、組織文化や規制、倫理的な懸念に根ざしていることが多いです。金融、医療、製造といった厳格な規制環境にある業界では、以下のような懸念が一般的です。

- AIによるテスト判断の「説明責任」の欠如

- 社内の品質基準や外部の法的規制への準拠

- AIが生成したテストが重大な欠陥を見逃した場合の責任の所在

日本企業においてAIテスト導入が慎重な理由

日本企業は高い技術力を持ちながらも、他の市場と比較してソフトウェアテストにおけるAI活用の進展が緩やかな傾向にあります。これは革新を拒んでいるのではなく、日本独自の深く根付いた「品質哲学」に起因しています。

品質に対する極めて強い責任感

日本のQAチームは、製品品質に対して非常に強い個人的・組織的責任を負っています。不具合は単なる「システムの不備」ではなく、チームの「至らなさ」として捉えられる傾向があります。このような文化において、テストの意思決定をAIという「ブラックボックス」に委ねることは、心理的・文化的に大きなハードルとなります。

失敗を許容しない「ゼロバグ」文化

多くの日本組織では、リリーススピードよりも「欠陥ゼロ」を最優先事項としています。AIは最適化や確率論的な判断には優れていますが、本質的に不確実性を伴います。リスク回避志向が強い環境では、AIによるわずかな判断ミスのリスクが、効率化というメリットを上回ってしまうと判断されがちです。

属人化・高度化したテストノウハウ

日本におけるテストの専門性は、長年の現場経験や「職人芸」とも言える暗黙知によって支えられています。こうした高度な知見は標準化やデータ化が難しく、AIによる自動生成やインサイトでは代替しきれないという懸念が、導入を躊躇させる一因となっています。

ソフトウェアテストにおけるAI活用時のポイント

ソフトウェアテストにおけるAI活用を成功させるには、技術、プロセス、そして「人」の最適なバランスを深く考慮することが不可欠です。成功を収めている組織は、AIを単なる「自動化の近道」としてではなく、中長期的な組織能力として捉えています。品質、説明責任、そしてシステムの安定性が何よりも優先されるエンタープライズ環境において、このマインドセットは非常に重要です。

人間中心のテストを加速させる手段としてのAI

AI主導のテストにおける最も重要な原則は、AIは人間の能力を「置き換える」ものではなく「拡張する」ものであるという認識です。AIは膨大なデータ分析やパターンの検知、反復作業の実行において圧倒的な力を発揮しますが、ビジネスの意図やユーザー体験、あるいは曖昧な要件を評価するための文脈理解力は持ち合わせていません。

実務においては、回帰テストの実行、ログ分析、テストの優先順位付けといった「機械的な作業」をAIに任せることで、テスターが探索的テストやリスクに基づく意思決定といった、より付加価値の高い活動に集中できる環境を整えるのが最も効果的です。この「Human-in-the-loop」アプローチは、テストの質を向上させるだけでなく、責任と判断を人間が担うという、品質至上主義の文化にも合致した手法です。

AI駆動型テストを支える専任チームの構築

AI導入を成功させるには、既存の各チームに断片的に責任を負わせるのではなく、明確な役割を持つ専任のテストチームを編成することをお勧めします。このチームは、テストの専門知識、自動化スキル、そして基本的なデータリテラシーを兼ね備えている必要があります。

専任チームは、従来のテスト手法とAIを融合させた新しいワークフローを繋ぐ「架け橋」となります。また、個々のテスターが持つ「暗黙知」を段階的に共有資産へと変換し、属人化を防ぐ役割も果たします。自社内でのリソース確保やAIの知見に不安がある場合は、外部の専門的なソフトウェアテスト会社とパートナーシップを組むことが、迅速かつ持続可能な導入を実現するための有効な手段となります。

戦略的資産としてのデータ品質

AIシステムの性能は、学習データの質に直結します。ソフトウェアテスト AIにおいては、過去の不具合データ、実行ログ、コードの変更履歴、ユーザーからのフィードバックなどがこれに該当します。こうした情報をAIが意味のある結果を出せるように洗浄・構造化・標準化するには、想像以上の労力が必要であることを理解しておく必要があります。

いきなり大規模なAI導入を試みるよりも、まずは既存のテストプロセスにおける「データ管理の規律」を高めることから始めるのが現実的です。不具合カテゴリの統一やテストレポートの集約といった小さな改善の積み重ねが、将来的にAIから得られるインサイトの精度を大きく左右することになります。

説明可能なAIによる信頼の構築

品質保証の判断には大きな責任が伴うため、AIの導入には「信頼」が欠かせません。なぜAIがそのテストケースを優先すべきと判断したのか、なぜ特定のモジュールを高リスクと判定したのかを、QAリーダーやステークホルダーが理解できる必要があります。

ここで重要になるのが、結論に至るプロセスが透明な「説明可能かつ追跡可能なAI」です。AIの判断根拠が可視化されていれば、チームは安心してその結果を検証でき、社内のガバナンス基準を遵守しながら段階的にテスト AI 自動化を進めることができます。多くの場合、AIは「意思決定の推奨エンジン」として活用し、最終的な判断は経験豊富なテスターが行う形がベストです。

自動化率に捉われない成功の測定

最後に、AI導入の成否を「テストの何割が自動化されたか」という指標だけで判断すべきではありません。より本質的な指標は、フィードバックサイクルの短縮、高リスク領域での欠陥検出率の向上、本番環境での障害減少、そして開発とQAチーム間の円滑なコラボレーションにあります。

AIがこれらの成果に寄与しているとき、それは単なるツールを超え、継続的な品質向上のための戦略的な柱となります。

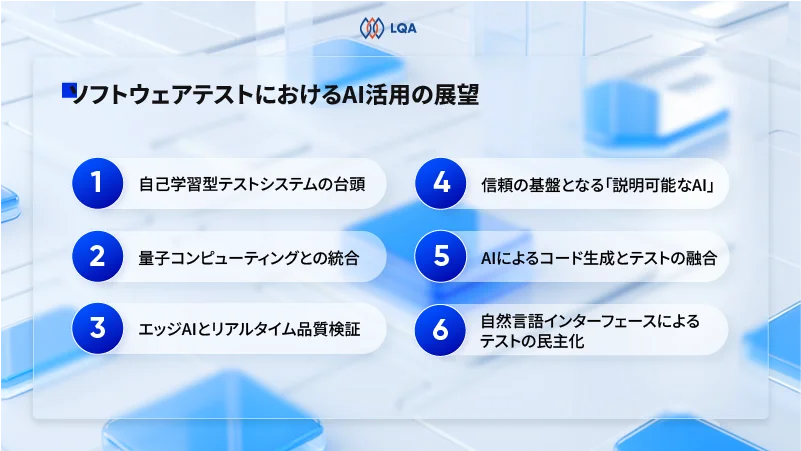

ソフトウェアテストにおけるAI活用の将来展望

AI技術の成熟に伴い、ソフトウェアテストにおけるAIの役割は、単なる「タスクの自動化」から「インテリジェントな品質エンジニアリング」へと進化していくことが予想されます。将来のAI駆動型テストシステムは、既存のワークフローを加速させるだけでなく、ソフトウェアライフサイクル全体における品質の計画・評価・改善のあり方そのものを再定義していくでしょう。

ソフトウェアテストにおけるAI活用の将来展望

自己学習型テストシステムの台頭

最も革新的な進展の一つは、「自己学習型テストシステム」の登場です。これらのシステムは、過去のテスト実行結果、不具合のパターン、コードの変更履歴、さらには本番環境でのインシデントから継続的に学習し、テスト戦略を自律的に洗練させていきます。静的なルールや手動更新が必要なスクリプトに頼るのではなく、AIモデルが現実の挙動に基づいて、テスト網羅率、実行順序、リスクの焦点を動的に調整します。

これにより、リリースを重ねるごとにテストはより「賢く」なっていきます。自己学習型システムは、故障しやすい箇所を予測し、冗長なテストを削減することで、手動の工数を増やすことなく、チームをより効果的な品質判断へと導きます。

量子コンピューティングとの統合

初期段階ではありますが、AI主導のテストと量子コンピューティングの統合は、長期的に極めてエキサイティングな可能性を秘めています。量子コンピューティングは、従来のシステムでは不可能だった規模の複雑な状態の組み合わせや最適化問題を処理する能力を持っています。

ソフトウェアテストの領域では、将来的に以下のような活用が期待されます。

- 超大規模なテストシナリオの最適化

- 極めて複雑なシステムにおける高度なリスクモデリング

- ミッションクリティカルなアプリケーションにおける相互依存コンポーネントの高速分析

実用化にはまだ時間を要しますが、今からテストデータの構造化やAIワークフローの整備を進めている組織こそが、将来のこうした技術革新を最大限に活用できるポジションを確立できるでしょう。

エッジAIとリアルタイム品質検証

IoTシステム、自動運転、スマートインフラなど、エッジデバイス上で動作するアプリケーションが増加する中で、テスト戦略も進化を迫られています。エッジAIは、インテリジェンスをデバイスの近くで動作させることで、実際の使用環境下でのリアルタイムな検証を可能にします。

これは、リリース前テストを超えた「継続的な品質モニタリング」を支える技術です。エッジにデプロイされたAIモデルが、本番環境での異常やパフォーマンスの低下、予期せぬ挙動を検知し、そのインサイトをテストプロセスへフィードバックします。その結果、開発・テスト・実利用の間に、より強固なフィードバックループが構築されます。

信頼の基盤となる「説明可能なAI(XAI)」

AIがテストの優先順位付けや意思決定においてより大きな役割を担うようになると、その「説明可能性」は譲れない要件となります。説明可能なAI(XAI)は、AIの出力を人間にとって透明で解釈可能、かつ追跡可能なものにすることに焦点を当てています。

ソフトウェアテスト AIの分野において、XAIは「なぜそのテストケースが優先されたのか」「なぜそのモジュールが高リスクと判定されたのか」をチームが理解することを可能にします。この透明性は、品質に対する説明責任が極めて重要であり、意思決定に監査可能性(オーディタビリティ)が求められる環境において不可欠です。XAIは人間のコントロールを弱めるのではなく、テスターとAIシステムの協働をより強固なものにします。

AIによるコード生成とテストの融合

テストの未来は、AIによるコード生成技術とも密接に関連しています。AIツールが開発者のアプリケーションコード生成を支援するようになると同時に、それに対応するテストケース、アサーション、検証ロジックも自動生成されるようになります。

この融合により、開発とテストの伝統的な境界線は曖昧になっていきます。テストはSDLCのより早い段階に組み込まれ、迅速なフィードバックと欠陥流出の防止を実現します。適切に管理されたAIによるコード・テスト生成は、ビジネスロジックやエッジケースに対する人間の監視を維持しつつ、一貫性と網羅率を大幅に向上させます。

自然言語インターフェースによるテストの民主化

自然言語インターフェースは、ソフトウェアテストをよりオープンなものにするための大きな一歩です。テスター、プロダクトオーナー、さらにはビジネス側のステークホルダーが、コードを書くことなく、自然言語を用いてテストシナリオや受け入れ条件、検証ルールを定義できるようになります。

AIシステムはこれらの入力を実行可能なテストへと変換し、技術的な障壁を取り除いてチーム間のコラボレーションを促進します。これは、テクニカルな担当者と非テクニカルなステークホルダー間の明確なコミュニケーションが品質に直結する複雑なプロジェクトにおいて、特に価値を発揮します。

これらのトレンドは、ソフトウェアテストにおけるAI活用が、単なる「補助ツール」から「インテリジェントな品質パートナー」へと進化することを物語っています。今からプロセス、データ、そしてチームをこの方向性へと整合させていく組織こそが、将来にわたって持続可能な品質の卓越性を達成できるのです。

LQA:ソフトウェアテストとAI活用における信頼できるITパートナー

AIをソフトウェアテストへ効果的に導入するには、深いテストの専門知識、確かな実行力、そして「品質がいかに構築されるか」という本質的な理解を持つパートナーが不可欠です。

ベトナム初の独立系ソフトウェアテスト専門企業として、LQAは10年以上にわたり、手動テストおよび自動テストの両面で豊富な実務経験を積み重ねてきました。この伝統的なテスト規律における強固な基盤こそが、AI主導のテストを成功させる鍵となります。なぜなら、AIは既存のQAプラクティスを置き換えるものではなく、それらを土台として進化させるものだからです。LQAは品質保証の本質を深く理解しており、AIを制御可能かつ効果的、そして測定可能な形でプロセスへ導入することを保証します。

最先端のAI人材と技術力の融合

従来のテストにとどまらず、LQAはAIや機械学習(ML)などの最先端技術を使いこなすIT人材の育成に注力しています。AIを活用したソリューションの開発だけでなく、回帰テスト、テストの最適化、バグ予測、テスト分析といった実務レベルのテストプロセスへのAI統合に精通しています。この「テストの知見」と「AI技術」のデュアルな能力により、イノベーションと運用の安定性の架け橋となります。

業界特有のニーズに応えるドメイン知識

幅広い業界におけるドメイン知識も、LQAの大きな差別化要因です。自動車、小売、建設、ホスピタリティなど、品質・安全性・信頼性が極めて重視される分野で広範な経験を蓄積してきました。ドメインの専門知識とAIを駆使したソフトウェアテストを組み合わせることで、トレーサビリティやコンプライアンスを維持しながら、お客様の複雑な要件に対応します。

国際基準に裏付けられた信頼性

LQAの信頼性は、ソフトウェアテストに関連する数多くの受賞歴や国際認証によって証明されています。これらは、弊社の国際的な品質基準へのコミットメントと、継続的な改善の姿勢を反映したものです。

これらの実績は単なる肩書きではありません。弊社の専任チームに深く根付いた、再現性の高いプロセス、成熟したメソドロジー、そして強力な品質文化を象徴しています。

ベトナムITパートナーとしての価値

ベトナムのITパートナーとして、LQAは技術的な卓越性、コスト効率、そして柔軟性の最適なバランスを提供します。お客様と密接に連携して専任のQAチームを構築し、進化し続けるプロジェクトのニーズに適応しながら、「製品品質の向上」「テストサイクルの短縮」「テストコストの最適化」という具体的な成果をお届けします。

結論

AIは、ソフトウェアテストを従来の手作業中心でリアクティブな活動から、よりインテリジェントでプロアクティブな品質保証へと変革させています。適切に導入することで、テスト AI 自動化による効率化、リスク予測の精度向上、そして迅速なフィードバックが実現します。その一方で、複雑な文脈を読み解く検証や品質保証の最終判断においては、依然として人間のテスターが不可欠な役割を担い続けます。

しかし、AI導入を成功させるために必要なのは技術だけではありません。AIを既存のテスト基盤と整合させ、熟練したチームを育成し、自動化と説明責任のバランスを保つ「人間中心のアプローチ」を採り入れる必要があります。このバランスを早期に確立した企業こそが、増大し続けるシステムの複雑性に対応し、将来のイノベーションをリードする準備を整えることができるのです。

ソフトウェアテストにおけるAI活用を効果的に進める方法を模索されているなら、豊富な実績を持つLQAをパートナーに選ぶことが、リスクを最小限に抑え、成果を加速させる最善の道となります。信頼できるベトナムのITパートナーとして、LQAは品質やガバナンスを損なうことなく、確信を持ってAI駆動型のテストを設計・実施・拡大するための最適なソリューションを提供いたします。

- Website: https://lotus-qa.com/jp/

- Tel: (+84) 24-6660-7474

- Mail: [email protected]

- Fanpage: https://www.linkedin.com/company/lts-japan/